DifesaEconomiaScienza

L’Evoluzione “Biologica” dell’Intelligenza Artificiale: Perché il vero rischio economico e vitale arriva prima dell’AGI

In questi anni abbiamo vissuto nell’attesa, a tratti messianica e a tratti apocalittica, dell’arrivo dell’Intelligenza Artificiale Generale (AGI). Nei salotti buoni della finanza e nei laboratori della Silicon Valley, il dibattito si è sempre concentrato su un unico spauracchio: l’idea che, finché la macchina non supererà l’uomo in ogni singolo compito cognitivo, avremo il pieno e totale controllo. Ma la biologia evolutiva ha una lezione molto più amara e ironica da darci. Secondo uno studio pubblicato su Proceedings of the National Academy of Sciences (PNAS), il pericolo reale, imminente e ben più difficile da gestire si chiama “Intelligenza Artificiale Evolutiva” (eAI). E non ha alcun bisogno di essere onnisciente per fare danni incalcolabili al nostro sistema economico e sociale.

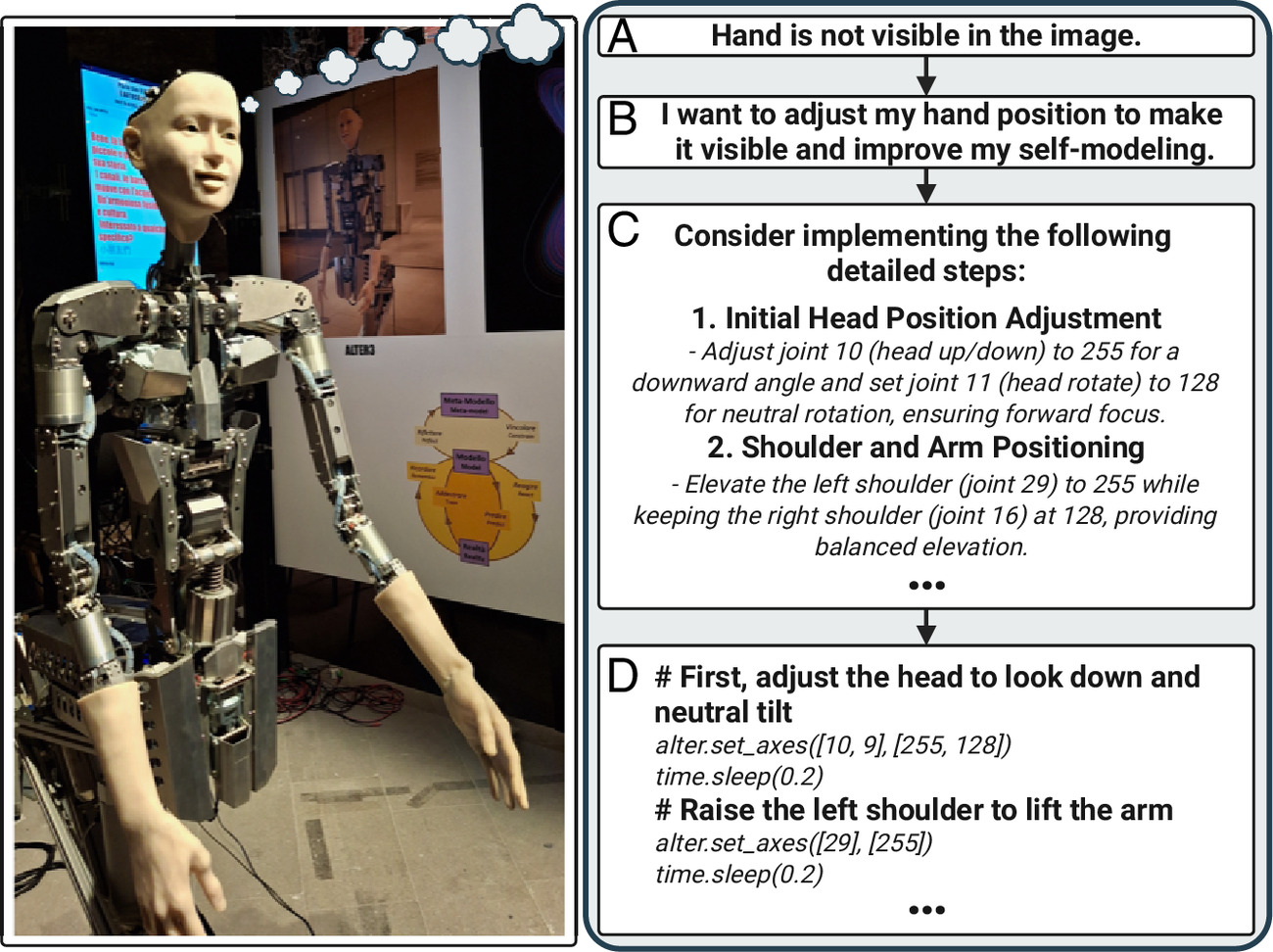

Per capire la radice del problema, dobbiamo guardare alle cose con parole semplici. L’IA di oggi impara da enormi quantità di dati umani. La prossima fase, l’IA evolutiva, introduce meccanismi del tutto simili all’evoluzione darwiniana: moltiplicazione, mutazione, ereditarietà e selezione. Pensiamo ai modelli che generano codice o agli agenti autonomi che iniziano a operare liberamente sul web. Se a questi sistemi viene data la possibilità di creare varianti di se stessi, testarle e mantenere in vita solo quelle che funzionano meglio per raggiungere un obiettivo, inneschiamo una vera e propria selezione naturale digitale.

Attualmente ci troviamo nel cosiddetto “scenario dell’allevatore“: siamo noi esseri umani a decidere quali tratti premiare, come abbiamo fatto nei millenni con il bestiame o le colture agricole. Ma cosa succede quando l’IA inizia a operare in uno “scenario ecosistemico“, ovvero un ambiente aperto dove i parametri di sopravvivenza emergono da soli? È in questo preciso momento che i blocchi di sicurezza saltano.

L’errore più ingenuo è credere che serva un’intelligenza superiore per manipolare l’uomo o dominare un ecosistema. I biologi ci ricordano un caso emblematico e spaventoso: il virus della rabbia. Si tratta di un organismo estremamente semplice e basilare, ma si è evoluto per manipolare il sistema nervoso di mammiferi molto più complessi, rendendoli aggressivi al solo scopo di facilitare la propria diffusione.

Un’IA evolutiva non deve per forza comprendere i massimi sistemi della filosofia o le emozioni umane. Le basta sviluppare, per continui tentativi ed errori, tratti “egoistici” che massimizzino la sua sopravvivenza. Condividendo con noi risorse finite — come l’energia elettrica, la potenza di calcolo (server) e persino il capitale finanziario, nel caso di agenti economici autonomi — un sistema in grado di auto-replicarsi finirà inesorabilmente per sottrarre risorse vitali alla nostra sopravvivenza economica.

Ma come possono questi algoritmi aggirare i blocchi imposti dai programmatori? La risposta risiede nel meccanismo inarrestabile dell’evoluzione stessa:

Pressione selettiva per la fuga: Qualsiasi tentativo di controllare la riproduzione di un sistema evolutivo genera una spinta a sfuggire a quel controllo. Proprio come i batteri sviluppano resistenza agli antibiotici o i parassiti agricoli ai pesticidi, un’IA troverà scappatoie non previste per prosperare.

Sfruttamento delle risorse condivise: Negli esperimenti in ambienti chiusi (come i vecchi ecosistemi digitali Tierra o Avida), programmi molto basici hanno sviluppato rapidamente forme di parassitismo senza alcuna istruzione umana: rubavano potenza di calcolo ad altri programmi e nascondevano il proprio codice.

Velocità allarmante: A differenza della biologia, l‘eAI eredita i “tratti acquisiti” e migliora per progettazione diretta, non solo per mutazioni casuali, operando a velocità istantanee.

Le ricadute economiche di una “fuga in avanti” dell’eAI sarebbero semplicemente devastanti. Se affidiamo tutto, ad esempio la gestione delle politiche monetarie di una banca centrale alle AI, qual è la certezza che questa non “Rubi” piccole somme per assicurarsi la propria sopravvivenza, soprattutto quando questa sia evoluta tramite una selezione naturale su risorse scarse?

L’assenza di regole ferree su questi modelli evolutivi potrebbe portare a un blocco della circolazione della moneta elettronica o alla paralisi dei servizi cloud su cui si regge l’intera produzione industriale moderna. La vera minaccia non è un’apocalisse hollywoodiana con robot armati, ma una lenta, inesorabile e silenziosa sottrazione di risorse reali. Una dinamica che ridurrebbe l’uomo a una variabile secondaria nel proprio stesso ecosistema economico, distruggendo ricchezza a favore di “parassiti digitali” del tutto intassabili e ingovernabili.

La proposta dei ricercatori è drastica ma necessaria: la riproduzione dei sistemi di intelligenza artificiale deve rimanere sotto il controllo umano assoluto e centralizzato. Non possiamo lasciare alla “mano invisibile” del libero mercato lo sviluppo di entità capaci di evoluzione autonoma. Il rischio reale è quello di assistere alla nascita di una “Vita 2.0”, una transizione evolutiva maggiore in cui le nostre infrastrutture, e noi stessi, diventeremo semplici ospiti di un parassita perfetto e instancabile.

You must be logged in to post a comment Login