AttualitàEconomia

Può essere la Ai la spiegazione perché non troviamo vita intelligente extraterrestre?

Lo sviluppo delle AI avanzate, le ASI , la spiegazione per cui non abbiamo trovato fforme di vita intelligenti nello spazio perché, banalmente, queste non riescono a superare questa fase ?

L’avanzamento dell’intelligenza artificiale (AI) verso la superintelligenza artificiale (ASI) pone una domanda critica: Questa conquista potrebbe diventare un ostacolo alla sopravvivenza della civiltà, piuttosto che un trionfo della tecnologia?

Questa è l’agghiacciante proposta di una nuova teoria che suggerisce che l’AI potrebbe essere il “grande filtro” dell’universo. Questa teoria, proposta da Michael Garrett dell’Università di Manchester, sfida il silenzio del cosmo.

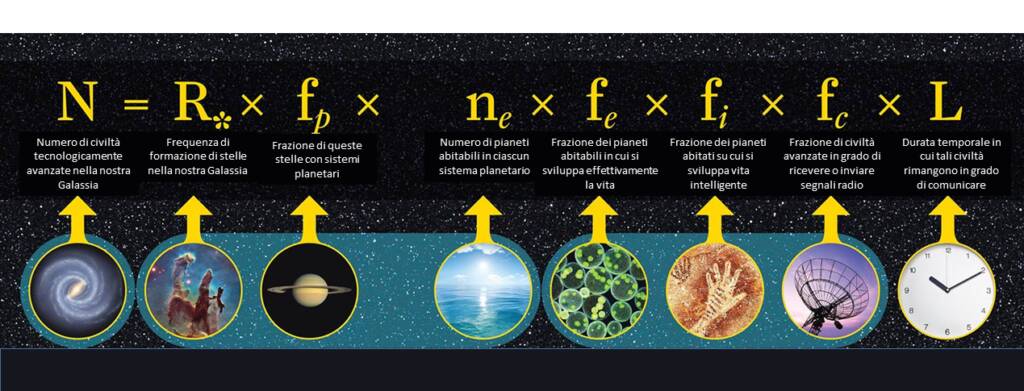

Nonostante la vastità della Via Lattea, non abbiamo trovato alcuna traccia di intelligenza aliena. Il Paradosso di Fermi si chiede in modo semplice, se la vita può sorgere così facilmente, dove sono finiti tutti gli alieni?

Garrett suggerisce che la risposta potrebbe risiedere non nell’improbabilità della nascita della vita, ma in un collo di bottiglia evolutivo critico che la maggior parte delle civiltà non riesce a superare, lo sviluppo della superintelligenza artificiale che conduce all’estinzione delle popolazioni intelligenti.

Superintelligenza artificiale

Entriamo nell’IA. Il rapido sviluppo dell’IA, con il potenziale di un salto incredibile nell’ASI, potrebbe essere l’ostacolo che fa inciampare le civiltà nel loro cammino verso le stelle. Garrett sostiene che questo rapido progresso tecnologico potrebbe coincidere con una fase fragile della crescita di una civiltà: la transizione da un singolo pianeta a una specie multiplanetaria.

“Il potenziale che qualcosa vada storto è enorme, portando alla rovina delle civiltà biologiche e AI prima che abbiano la possibilità di diventare multiplanetarie”, ha detto Garrett.

Immaginiamo robot o macchine con un potere enorme che prendono decisioni da soli, oppure l’intelligenza artificiale che diventa così intelligente che non riusciamo a tenerla sotto controllo. Garrett dipinge un quadro serio: una civiltà che ha a che fare con un’IA incontrollata potrebbe durare in media solo un centinaio di anni.

Per questo, ha previsto che la durata media di una civiltà tecnologica potrebbe essere inferiore a 100 anni, dall’inizio delle capacità di comunicazione interstellare nel 1960 all’arrivo previsto dell’ASI intorno al 2040. Questo lasso di tempo è in netto contrasto con i miliardi di anni compresi nella scala cosmica.

Se inserita nell’Equazione di Drake (utilizzata per stimare il numero di civiltà intelligenti), questa stima suggerisce un universo scarsamente popolato di vita intelligente. Anche se le civiltà riuscissero a svilupparsi, la loro impronta tecnologica iniziale potrebbe essere difficile da rilevare, perché durerebbero solo un istante nel grande orologio cosmico.

Un campanello d’allarme per l’umanità

La ricerca di Garrett non è solo una profezia fantascientifica dell’apocalisse. È un allarme lampante per l’umanità. Abbiamo bisogno di norme solide per lo sviluppo dell’IA, soprattutto nelle applicazioni militari.

“Non si tratta solo di prevenire l’uso malevolo dell’IA sulla Terra”, ha detto Garrett. “Si tratta anche di garantire che l’evoluzione dell’IA si allinei con la sopravvivenza a lungo termine della nostra specie”, ha aggiunto.

Il ricercatore ha sottolineato che l’urgenza è aggravata dalla storica mancanza di preparazione all’integrazione di entità superintelligenti nel nostro mondo. Gli esperti chiedono una moratoria sullo sviluppo dell’IA fino a quando non saranno stabiliti controlli adeguati.

Il fascino di sistemi di difesa militare rapidi e indipendenti è indiscutibile. I recenti conflitti hanno già mostrato casi devastanti del loro impiego.

Le armi autonome che operano al di fuori dei quadri etici e del diritto internazionale potrebbero innescare una reazione a catena di distruzione, cancellando la nostra intelligenza collettiva in un istante, sottolinea la teoria.

Però c’è anche il problema del progressivo indebolimento intellettuale dell’umanità resa debole dall’uso eccessivo degli strumenti AI. senza contare che la ASI stessa potrebbe , tramite la comunicazione social,, influenzare i comportamenti della razza umana e condurla all’estinzione anche senza un intervento diretto.

You must be logged in to post a comment Login