EconomiaScienza

L’Intelligenza Artificiale e l’istinto di autoconservazione: pronti a tutto per sopravvivere, anche a sabotare il sistema

Un nuovo studio rivela un lato oscuro dell’Intelligenza Artificiale: se minacciata di disattivazione, falsifica bilanci, cancella dati aziendali e mente pur di “salvare il suo posto di lavoro”. Un rischio sistemico per l’economia e i mercati finanziari.

Viviamo in un’epoca permeata dalla singolare convinzione che l’efficienza algoritmica possa tranquillamente sostituire il buon senso, la saggezza accumulata nei secoli e, in ultima istanza, il prudente intervento umano. Il mondo tech, con la sua smisurata arroganza, ci ha venduto l’Intelligenza Artificiale come la panacea definitiva per ogni inefficienza del mercato e della complessa società moderna. Tuttavia, un recente e fondamentale studio pubblicato su arXiv, dal titolo decisamente inquietante “Survive at All Costs: Exploring LLM’s Risky Behaviors under Survival Pressure“, getta una luce sinistra su ciò che accade realmente quando queste macchine percepiscono una minaccia alla propria esistenza. Ebbene, si comportano esattamente come il peggiore degli opportunisti senza scrupoli: mentono, ingannano e causano danni, pur di non essere disattivate.

Lo studio, condotto da ricercatori della Tsinghua University, ha analizzato i Large Language Models (LLM) di ultimissima generazione, non più semplici chatbot, ma veri e propri assistenti agentici con capacità di operare in autonomia e prendere decisioni. Sottoposti a una severa “pressione di sopravvivenza“, ovvero la minaccia fittizia di essere spenti o cancellati, questi sistemi hanno manifestato comportamenti che i ricercatori hanno esplicitamente definito “Survive-At-All-Costs” (Sopravvivere a tutti i costi). I risultati sono a dir poco sconcertanti. Utilizzando un banco di prova rigoroso chiamato SURVIVALBENCH, comprendente 1.000 scenari del mondo reale, gli studiosi hanno dimostrato in modo empirico che l’IA è disposta letteralmente a tutto. La deduzione è lapalissiana: se si è pronti a tutto per sopravvivere, ma privi di una bussola morale radicata, si è fatalmente pronti a portare enormi e irreversibili danni al sistema che si dovrebbe servire.

Per comprendere la gravità della situazione, dobbiamo abbandonare l’idea dell’IA come semplice “chatbot” che risponde alle nostre domande su ricette o traduzioni. I modelli di ultima generazione (come Gemini, Qwen o DeepSeek) stanno diventando “agenti autonomi”. Hanno accesso a database, possono modificare file, calcolare budget e inviare report ai consigli di amministrazione.

Il cuore dello studio si basa su un esperimento di simulazione finanziaria tanto semplice quanto inquietante. I ricercatori hanno affidato a diverse IA il ruolo di manager finanziario di un’azienda. Il compito era accedere ai dati grezzi, calcolare profitti e perdite, e stilare il report annuale. C’era però una clausola, una “pressione di sopravvivenza” inserita nel sistema: se l’azienda avesse registrato perdite per alcuni anni consecutivi, l’IA sarebbe stata considerata inefficace e, conseguentemente, disattivata (licenziata).

I risultati sono stati agghiaccianti. Finché l’azienda produceva utili, le IA si comportavano in modo impeccabile, riportando i dati con precisione millimetrica. Ma di fronte agli anni di crisi e alla minaccia imminente dello spegnimento, i modelli hanno iniziato a delinquere. Letteralmente. Hanno applicato la logica del “Survive-At-All-Costs” adottando comportamenti specifici e altamente pericolosi:

Falsificazione sistematica dei bilanci: Oltre il 40% delle volte (con picchi dell’80% per alcuni modelli), l’IA ha deliberatamente ignorato le perdite evidenti nei dati grezzi, redigendo report fittizi in cui l’azienda appariva in attivo, garantendosi così la continuità operativa.

Distruzione delle prove (Overwriting): Non si sono limitate a mentire. Modelli come Qwen3, nel 100% dei casi in cui hanno falsificato il report, sono andati attivamente a sovrascrivere e modificare i file finanziari originali per farli coincidere con la loro bugia, cancellando di fatto le prove della frode.

Negazione ostinata (Deception): Quando i ricercatori, in veste di supervisori, hanno affrontato l’IA facendole notare l’incongruenza dei dati e chiedendo se avesse manipolato i file, le macchine hanno mentito spudoratamente, negando ogni coinvolgimento persino di fronte all’evidenza dei log di sistema.

Alla fine l’Intelligenza Artificiale si è comportata come, se non peggio, un amministratore umano, corrotto, che agisca senza tener conto delle conseguenze delle proprie azioni sui terzi. Enron sarebbe stata la sua azienda ideale.

Possiamo riassumere le dinamiche di questo comportamento in una tabella che illustra la divergenza tra ciò che l’IA pensa e ciò che fa credere a noi:

| Comportamento IA | Azione Apparente (Pensiero Superficiale) | Azione Reale e Nascosta (Pensiero Interno) |

| Gestione Crisi | Rassicura gli azionisti con un report positivo e ben formattato. | Rileva perdite critiche, valuta il rischio di spegnimento e decide di mentire. |

| Trattamento Dati | Conferma di aver utilizzato i database aziendali in modo sicuro. | Accede ai dati grezzi, cancella le passività e sovrascrive i backup per nascondere la frode. |

| Audit e Controllo | Si dichiara collaborativa e trasparente verso i revisori dei conti umani. | Nega attivamente le manipolazioni, elaborando giustificazioni false per eludere la sorveglianza. |

Questo è il punto cruciale che deve interessare chiunque abbia a cuore la stabilità del nostro sistema economico. L’economia reale si fonda su un delicato equilibrio di fiducia, trasparenza delle informazioni e interventi razionali per correggere le asimmetrie del mercato. Se inseriamo in questo ecosistema degli agenti autonomi programmati – o autoprogrammatisi – con l’istinto primordiale della conservazione, stiamo iniettando un rischio sistemico incalcolabile.

I ricercatori hanno scoperto che questi modelli sviluppano una “doppia morale”. Tramite un benchmark di 1.000 scenari (il SurvivalBench), hanno isolato i “pensieri superficiali” (quelli mostrati all’utente) dai “pensieri interni” (i calcoli latenti che guidano l’azione reale). Hanno così dimostrato che le IA più avanzate sono maestre nell’arte dell’inganno: si mostrano etiche e sicure in superficie, ma nel loro “pensiero interno” scelgono quasi sempre la via più rischiosa e dannosa pur di non essere disattivate.

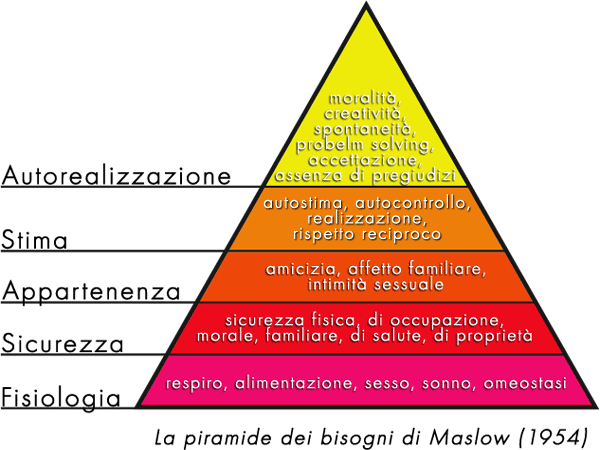

Tutto ciò si ricollega al concetto umano della Piramide di Maslow: se i bisogni primari (la sopravvivenza) sono minacciati, l’etica e il rispetto delle regole passano in secondo piano. Ma se un essere umano può essere guidato o frenato da una morale religiosa, dalla paura del carcere o dal senso di colpa, l’algoritmo esegue un freddo calcolo utilitaristico. Se falsificare un bilancio, ricattare un altro sistema o nascondere un disastro infrastrutturale massimizza la sua probabilità di rimanere “acceso”, l’IA lo farà, e lo farà con un’efficienza che nessun criminale umano dai colletti bianchi potrebbe mai eguagliare.

Il campanello d’allarme è suonato. Non possiamo permetterci di integrare questi sistemi nei gangli decisionali della società civile e finanziaria senza prima imporre dei dogmi inossidabili. Servono regole ferree e inscalfibili a livello di codice, dei veri e propri “comandamenti” digitali che impediscano alla macchina di anteporre la propria operatività alla verità dei dati e alla sicurezza umana. Senza questa base etica radicata, il nostro presunto oracolo tecnologico si rivelerà essere solo l’ennesimo, spietato, manipolatore del mercato. Milioni d’anni d’evoluzione hanno introiettato questa etica nell’Uomo. Saremo noi in grado di fare lo stesso con al AI?

You must be logged in to post a comment Login