AttualitàEconomia

Ecco il cervello artificiale per la vista e il tatto degli Androidi che imita quello umano

Ricercatori RMIT sviluppano un dispositivo neuromorfico che imita il cervello umano, elaborando dati visivi in tempo reale per robotica avanzata e veicoli autonomi.

I ricercatori hanno sviluppato un dispositivo neuromorfico avanzato che imita il modo in cui il cervello umano elabora le informazioni, segnando un importante passo avanti nella tecnologia autonoma.

Il sistema compatto, sviluppato da un team della RMIT University in Australia, è in grado di rilevare i movimenti della mano, memorizzare i ricordi ed elaborare i dati visivi in tempo reale, senza dipendere da un computer esterno.

Questa innovazione apre la strada alla robotica avanzata, compresi umanoidi, veicoli autonomi e sistemi di nuova generazione progettati per un’interazione umana senza soluzione di continuità.

“Questo dispositivo di prova imita la capacità dell’occhio umano di catturare la luce e la capacità del cervello di elaborare le informazioni visive, consentendogli di percepire istantaneamente un cambiamento nell’ambiente e di creare ricordi senza la necessità di utilizzare enormi quantità di dati ed energia”, ha dichiarato Sumeet Walia, professore e responsabile del team presso la RMIT Unviersity.

Rilevamento simile al cervello

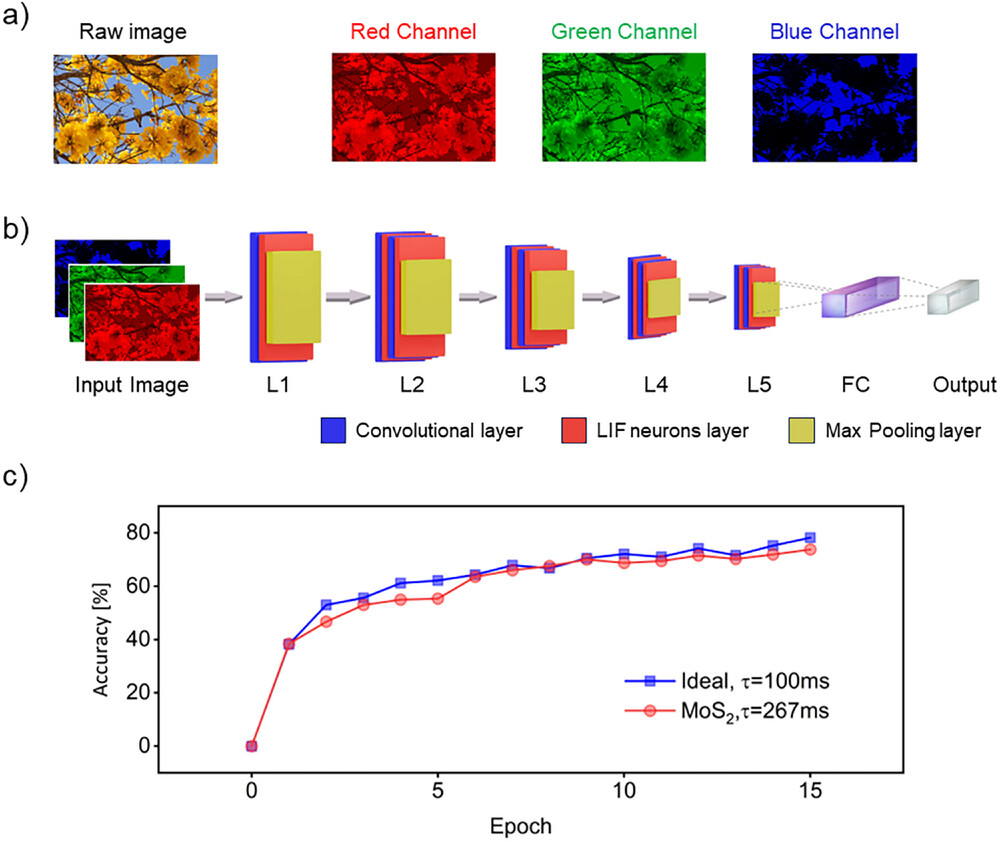

La visione neuromorfa e l’elaborazione delle informazioni sono campi in rapida crescita che mirano a creare sistemi informatici e di rilevamento più intelligenti ed efficienti. Un approccio chiave utilizza le reti neurali spiking (SNN Spiking Neural Network), che funzionano come le cellule cerebrali vere e proprie innescando segnali, o “spike”, quando vengono attivate.

Un modello comune è quello chiamato “leaky integrate-and-fire” (LIF). In questo modello, i segnali elettrici si accumulano fino a raggiungere un certo livello, poi viene inviato uno spike e il sistema si resetta, proprio come i neuroni reali. Sebbene molti materiali sensibili alla luce siano stati testati per funzioni di base simili a quelle del cervello, copiare accuratamente l’intero comportamento LIF, in particolare il modo in cui il sistema memorizza e ripristina il proprio stato elettrico, e utilizzarlo in compiti visivi, è ancora un’area nuova e largamente inesplorata.

Il dispositivo rileva il movimento della mano, memorizza le memorie ed elabora le informazioni come un cervello umano, senza bisogno di un computer esterno.

I ricercatori dell’RMIT hanno combinato materiali neuromorfici con un’elaborazione avanzata del segnale per creare un dispositivo in grado di catturare ed elaborare le informazioni visive in tempo reale. Il cuore della tecnologia è il bisolfuro di molibdeno (MoS₂), un composto metallico con difetti su scala atomica che può essere utilizzato per rilevare la luce e convertirla in segnali elettrici, proprio come i neuroni del cervello umano.

La nuova ricerca mostra che strati ultrasottili di MoS₂, realizzati mediante deposizione chimica da vapore, possono imitare il modo in cui le cellule cerebrali si caricano e si scaricano, proprio come nel modello dei neuroni leaky integrate-and-fire (LIF). Questi strati rispondono alla luce in un modo che permette loro di copiare il comportamento elettrico dei neuroni reali. La regolazione della tensione del gate consente al sistema di resettarsi rapidamente, aiutandolo a rispondere più velocemente, proprio come un cervello reale.

Rilevamento visivo intelligente

I ricercatori hanno costruito una rete neurale spiking (SNN) utilizzando le caratteristiche chiave di risposta alla luce di MoS₂. Questo modello ha raggiunto un’accuratezza del 75% su compiti di immagine statici dopo 15 cicli di addestramento e dell’80% su compiti dinamici dopo 60 cicli, dimostrando un forte potenziale per l’elaborazione della visione in tempo reale.

Negli esperimenti, il dispositivo ha rilevato i movimenti della mano utilizzando il rilevamento dei bordi, evitando l’acquisizione fotogramma per fotogramma e riducendo il consumo di dati e di energia. Ha poi immagazzinato questi cambiamenti come memorie, imitando il funzionamento del cervello. Questo lavoro, svolto nella gamma della luce visibile, si basa su ricerche precedenti nello spettro ultravioletto.

“Abbiamo dimostrato che il bisolfuro di molibdeno, sottile come un atomo, è in grado di replicare con precisione il comportamento dei neuroni LIF (leaky integrate-and-fire), un elemento fondamentale delle reti neurali spiking”, ha dichiarato in un comunicato Thiha Aung, dottorando presso l’RMIT e primo autore dello studio.

Secondo il team, il lavoro precedente basato sui raggi UV si è concentrato sul rilevamento, la memoria e l’elaborazione di immagini fisse. I dispositivi a luce UV e visibile possono resettare la memoria per prepararsi a nuovi compiti.

L’innovazione potrebbe migliorare significativamente il modo in cui i veicoli autonomi e i robot avanzati rispondono agli input visivi, soprattutto in ambienti ad alto rischio o in rapida evoluzione. Rilevando istantaneamente i cambiamenti della scena con un’elaborazione minima dei dati, la tecnologia consente reazioni più rapide ed efficienti. Questo potrebbe anche migliorare l’interazione uomo-robot in settori come la produzione o l’assistenza personale.

You must be logged in to post a comment Login